For noen måneder siden hadde jeg en videokonferanse med et ungt menneske som lurte på om hun skulle søke doktorgradsstudium på BI. Vedkommende var atypisk i mange dimensjoner fra de fleste doktorgradsstudenter jeg har møtt, men hadde tatt en mastergrad, likte jobben med masteroppgaven, og lurte på om det å fordype seg ytterligere kunne være det neste. I tillegg – og her er poenget – hadde hun blitt anbefalt å vurdere en doktorgrad av sin AI-baserte coach.

Vi diskuterte litt frem og tilbake, og jeg anbefalte henne å søke. Om hun gjorde det, vet jeg ikke. Men jeg ble sittende og tenke etterpå.

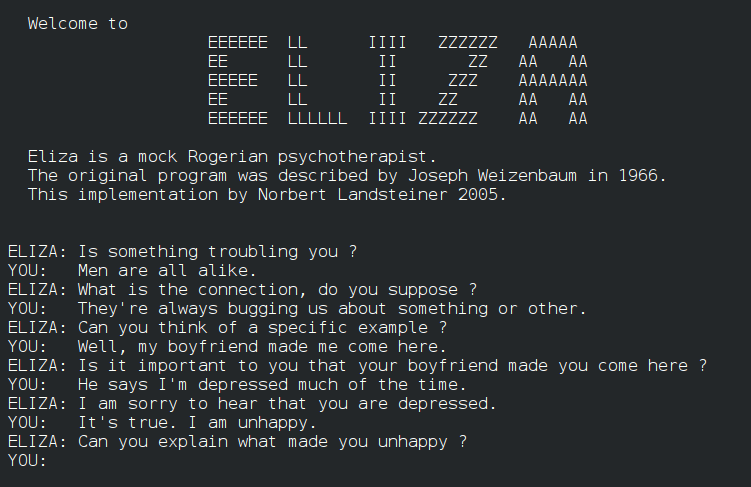

Det å ha en coach, terapeut, rådgiver eller for den saks skyld venn å snakke med, er jo i seg selv ikke noe negativt. Ei heller er det negativt at denne coach’en er digital – den er i alle fall billig (foreløpig) og tilgjengelig til alle døgnets tider. Gitt at den er «promptet» skikkelig (rolle, situasjon, målsetting) vil vel også svarene være noe i retning av hva en menneskelig coach. Og digitale samtalepartnere har jo lange tradisjoner, som Joseph Weizenbaums Eliza viste – i 1966!

Men hva slags motivasjon har en slik coach – eller, for å si det på AI-språket: Hva er dens belønningssystem (reward function), og hvordan påvirker målsettingen hvilke svar den gir?

Svaret er at de i hovedsak er designet til å være hyggelige mot oss.

Belønninger former resultater

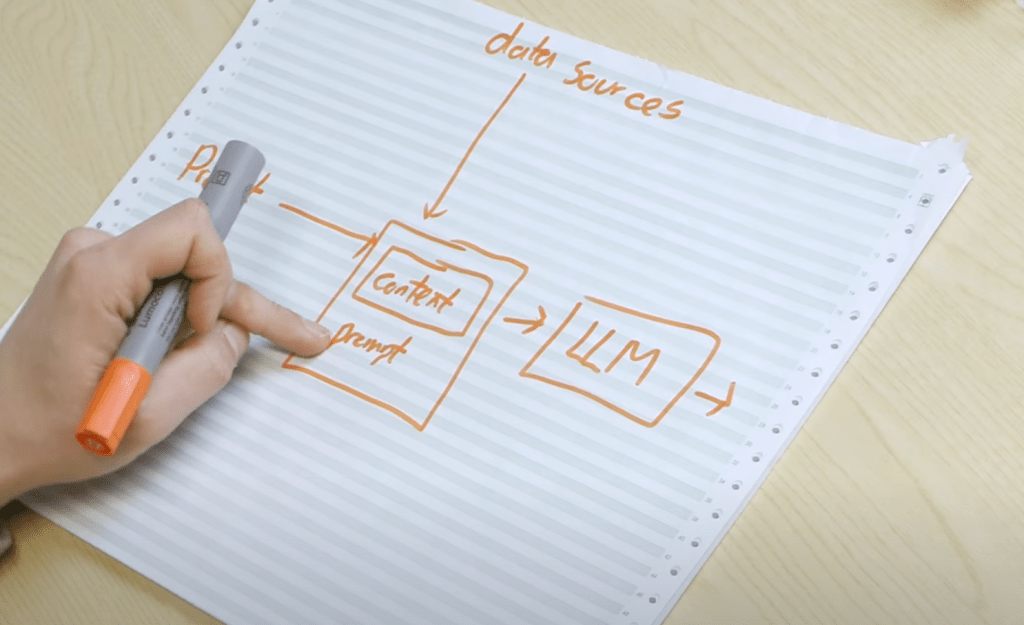

Store språkmodeller svelger enorme tekstmengder og trener seg opp å forutsi neste ord i en rekkefølge, ved en rekke matematiske prosesser, hovedsaklig matriseregning (glimrende forklart i denne videoserien.) Etter denne treningen gjennomgår modellen en finpussfase kalt Reinforcement Learning from Human Feedback (RLHF). Mennesker rangerer modellens svar, og modellen justeres mot å produsere svar med høy rangering. Et av problemene med denne prosessen er at vi mennesker liker å få rett: Vi liker svar som bekrefter våre antagelser, som er formulert med selvtillit og en viss autoritet, og som ikke utfordrer oss for mye. Dermed lærer ikke nødvendigvis modellene å bli sannferdige eller kloke. De lærer å være behagelige.

Dette blir et utbredt problem etterhvert. Sharma et al (2023) fant at ulike modeller hadde en tendens til å være smigrende. (Det engelske utrykket er sycophancy. Jeg har ikke funnet noe direkte norsk oversettelse av dette. Og jeg som trodde sykopant og sykopantisk var norske ord. Akk ja. Herved foreslått.) Modellene endrer korrekte svar når brukeren uttrykker tvil, gir etter for press selv om de har rett, og tilpasser meninger til hva brukerne signaliserer at de ville høre.

Av og til kan smigeren bli for åpenbar: I april 2025 slapp OpenAI en oppdatering av GPT-4o som hyllet trivielle innfall som geniale, bekreftet tvilsomme forretningsidéer som strålende, og strøk brukerne såpass mye med hårene at det ble pinlig. OpenAI rullet tilbake oppdateringen og publiserte en forklaring der de innrømmet at de hadde lagt for mye vekt på kortsiktige tilbakemeldinger fra brukerne i treningsprosessen.

Problemet er at det er ikke så lett å måle om et svar er godt, i hvert fall ikke en måte som er skalerbar, rask og billig. Reinforcement learning – å la maskinen prøve seg om og om igjen til ting blir riktig – fungerer så lenge det finnes et klart formulert mål, enten dette er å spille Breakout eller diagnostisere kreft. Det å ikke ha data – spesifikt, data med korrekte svar å trene mot – er den vanligste grunnen til at analyseprosjekter mer eller mindre mislykkes, noe jeg har sett mange ganger i kursene mine.

Problemstillingen kalles «AI alignment» og er ikke enkel. Anthropic har forsøkt seg med noe de kaller «constitutional AI«, som i hovedsak går ut på å la modellen måle sine svar opp mot anerkjente verdier – som FNs menneskerettighetserklæring. Dette er også en teknikk som blir anbefalt av produsentene av modellen selv: Bruk modellen til å være kritisk til hva den selv sier.

Digital Trumpisme

Donald Trump omgir seg med rådgivere som snakker ham etter munnen. Han har klart målbare målsettinger – kortsiktig popularitet og kortsiktig økonomisk gevinst – og ingen som helst sperre på hvor sterkt og åpent de uttrykkes. Siden han kan velge sine medarbeidere, foretrekker han de som skryter av ham heller enn å gi ham motstand, og dermed ender man opp med noksagter som Pam Bondi, fanatikere som Pete Hegseth eller værhaner som JD Vance.

Den katolske kirken hadde tidligere noe som heter «djevelens advokat» – en person som har som oppgave å argumentere kraftig og nesten vitenskapelig mot at en person skal erklæres for helgen. Christopher Hitchens var ganske imponert over de katolske geistlige som besøkte ham da Mor Theresa skulle kanonseres. De lyttet nøye til hans motforestillinger både mot hennes gjerning og de miraklene som skulle gi henne helgenstatus – men trass i gode begrunnelsen ble hun altså helgen. Med andre ord, det hjelper lite å ha institusjonelle motforestillinger, digitale eller ikke, hvis de ikke blir lyttet til.

Og dit kommer vi kanskje. Jeg har hatt en hel del studenter som har kommet til meg med AI-resultater og presentert dem som sine egne. Men jeg har ennå ikke hatt noen som har insistert på at det AI har produsert er sant, og lurer litt på når det skjer og hva jeg skal si da (uten å eksplodere). Den første generasjonen studenter som har hatt tilgang til språkmodeller uteksamineres i disse dager, og de liker ikke AI, delvis fordi de er usikre på om de faktisk kan noe, delvis fordi arbeidsmarkedet for nyutdannede er dårligere enn det har vært på lenge, noe som tilskrives AI.

Men det spørs jo om ikke det behagelige etter hvert blir det sanne og eneste. Slik det har blitt for Trump.

(Og ja, jeg startet dette innlegget med Claude, men endte opp med å skrive neste hele greia selv, siden jeg skriver forblommet nok som det er, uten hjelp fra en entusiastisk språkmodell.)