I desember i fjor var jeg med på en interessant podcast med Bente Sollid og Christian Brosstad, der temaet var hva som vil skje med arbeids- og forretningslivet nå som AI kommer inn for fullt. Temaet var opprinnelig «KI-blodbad i arbeidslivet» eller noe slikt, men både Bente og jeg likte ikke den tittelen, selv om den er skikkelig klikkbar. Det ble en lang og vidtfavnende samtale, vi endte opp med å diskutere forretningsmodeller en hel del. Etterpå sa Bente at vi kanskje burde ha brukt mer tid på hvilke egenskaper og kunnskaper som blir viktige i en verden med mye AI – med andre ord, hva skal du bli flink i for fortsatt å ha en jobb og en god inntekt?

Så her er mitt forsøk på å starte den diskusjonen, og det har jeg tenkt å begynne med å observere at vi har hatt denne diskusjonen før – for sånn omtrent 20 år siden, for å være nøyaktig. Den gang var ikke trusselen mot arbeidslivet AI, men globalisering – hva i all verden skulle vi gjøre når billig arbeidskraft i India og Kina kom og tok alle IT- og industrijobbene? Det manglet ikke på spådommer om hvor vanskelig det ville bli å beholde jobbene i vesten, når milliarder, bokstavlig talt, av indere og kinesere og andre sto klare til å overta.

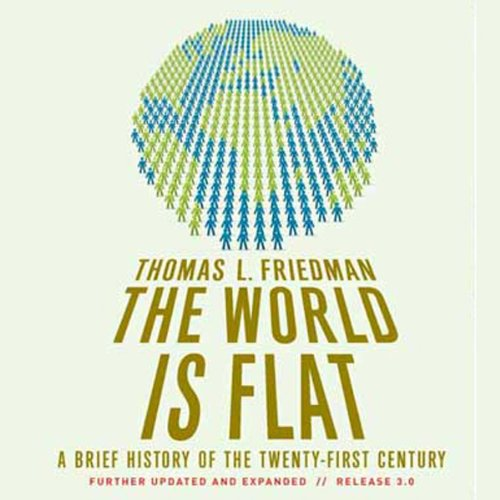

Den boken som dominerte den diskusjonen var Thomas Friedmans The World is Flat – du finner mitt sammendrag her – som hevdet at jorden var i ferd med å bli flatere, i den forstand at åpnere arbeidsmarkeder og finansmarkeder, hypereffektiv kommunikasjon og billig og rask transport ville gjøre verden til et sted der ting der alle nasjoner kunne konkurrere. Dette har vist seg å være en sannhet med modifikasjoner, men arbeidslivet er uten tvil endret, selv om det i alle fall for USAs vedkommende har handlet mer om automatisering av industriproduksjon enn outsourcing.

Nuvel, den samme Friedman diskuterte i alle fall hvordan man skulle ruste seg for å overleve i en verden der man konkurrerer globalt – og hans argumenter har en viss overføringsverdi når vi diskuterer hva som kommer til å skje når AI står for automatiseringen. Friedman mener at de som vil overleve er dem hvis jobb ikke kan outsources – the untouchables. Han mener det er fire typer av dem:

- De unike: Folk som er unike og ikke kan kopieres fordi ingen andre kan gjøre det de gjør – Erling Haaland, for eksempel, eller Taylor Swift.

- De spesialiserte: Folk som har en spesialkunnskap, som spesialiserte advokater, hjernekirurger, andre hvis arbeid rett og slett ikke kan automatiseres.

- De forankrede: Folk som gjør noe lokalt og tilpasset, som frisører, servitører, helsepersonnel og rørleggere.

- De fleksible: De som klarer å lære seg noe nytt, når hele eller deler av den jobben de utførte før blir automatisert. Den siste gruppen er den viktigste, fordi også de tre andre vil få deler av jobben sin automatisert.

Hovedmeldingen den gang – og i dag – er at man må hele tiden oppgradere seg, hele tiden lære, for å være relevant. Nå er det riktignok ikke en smart og ambisiøs inder som står og vil ha jobben din, men en mindre smart språkmodell som vil gjøre den delen av jobben din som bare krever middelmådige kunnskaper.

Problemet med å flytte masse arbeid til India var at man i stor grad undervurderte transaksjonskostnadene – det man vant ved å ha billige programmerere tapte man i den tiden det tok å spesifisere hva man ville ha gjort, i kulturforskjeller og tidssoneproblemer. Det betyr ikke at det ikke kan være lønnsomt, men at organisasjonen som skal flytte noe bør være stor nok til at man har penger og personell til å administrere det hele – og at man er stor nok til at man er en interresant kunde derover.

Slik er det kanskje med språkmodellene også: Riktignok kan man automatisere mye, men for mange (i hvert fall for meg) er jobben med å følge med på hva assistentene gjør så stor at jeg heller gjør det selv. Og uansett hvor bra en språkmodell er – det blir ikke helt som man vil ha det.

Kanskje det tyder på at jeg kommer til å overleve i det fremtidige arbeidslivet likevel?